1.

Einleitung ^

In seiner Ausgabe Juni 2012 meldet das deutsche Verbrauchmagazin «test», dass viele Apps personenbezogene Daten (§ 3 BDSG1) der Smartphone-Besitzer an Datensammler unverschlüsselt übertragen; «für den Service, den diese Apps bieten, zahlen Nutzer mit ihrer Privatsphäre»2. Von 63 geprüften Anwendungen stufte Stiftung Warentest 28 datenschutzrechtlich als kritisch ein. Darunter sind auch «sehr kritische» Anwendungen, zu denen bekannte Apps wie WhatsApp, Facebook, Foodspotting, iTranslate oder Clever tanken zählen.

Apps sind eine junge Entwicklung. Mit dieser einher zu gehen scheint leider auch, die Erhebung, Verarbeitung und Nutzung personenbezogener Daten ohne gesetzliche Erlaubnis (§ 4 I BDSG) und ohne Einwilligung (§ 4a BDSG) durchzuführen. Bundesverbraucherministerin Ilse Aigner warnte, die Sicherheit der Smartphones hinke der technischen Entwicklung oft hinterher.3 Auch Datenschützer Dix merkt an, dass derartig datenschutzfeindliche Geschäftsmodelle der «falsche Weg» seien; die Anbieter fragten User nicht etwa nach ihren Vorlieben, sondern beobachten sie.4

Es fragt sich aus datenschutzrechtlicher Sicht, wie einerseits personenbezogene Daten geschützt werden können; andererseits, so Dieter Kempf, dürfe es aber nicht so weit kommen, dass Internetdienste zu einem Hindernisparcours für User werden, sonst «verliert das Smartphone seinen Charme». Die benutzerfreundliche Nutzung einer App muss ermöglicht werden. Eine Lösung könnte das Prinzip des sog. «Privacy by ReDesign» (PbRD) bieten. Urheberin dieses Prinzips ist die Datenschutzbeauftragte von Kanada, Ann Cavoukian.5

2.1.

Begriffsbestimmung und Nutzerverhalten ^

Smart Devices gewinnen im Alltag zunehmend an Bedeutung. Im vergangenen Jahr machten sie weltweit bereits 70 Prozent aller Geräteverkäufe aus, in diesem Jahr soll der Absatz von 821 Millionen auf 1,2 Milliarden Geräte ansteigen.6 Dies bleibt auch in Deutschland nicht ohne Auswirkungen. Nach einer Umfrage im vergangenen Oktober nutzen 29,5 Millionen Deutsche ein Smartphone, was einem Anteil an Mobiltelefonen in Höhe von 35 % entspricht, bei den unter 30 Jährigen sind es gar 58 %.7 Die beliebtesten Funktionen bei Smartphones sind E-Mails lesen und Nachrichten über soziale Netzwerke austauschen. So prüfen 70 % der Männer und 55 % der Frauen täglich oder mehrmals die Woche ihre E-Mails auf dem Handy. 52 % der Männer und 61 % der Frauen tauschen sich in sozialen Netzwerken aus.8

Smart Devices verfügen also über die verschiedensten Anwendungsmöglichkeiten. Hierzu zählen mobiles Internet, Navigations-, Ortungs- und Kartendienste, mobiler E-Mail-Zugang sowie viele weitere hilfreiche Anwendungen – die sogenannten «Applications» oder kurz «Apps». «Mehr als 15 Millionen Handybesitzer nutzen Apps, im Schnitt sind 17 Programme pro Gerät installiert»9. 80 % aller Internetnutzer haben ein persönliches Profil im Internet, auf das sie auch über Smart Devices zugreifen könnten – das sind 43 Millionen Personen.

2.2.

Faktischer Datenumgang ^

Vielen Anwendern ist nicht bewusst, dass insbesondere viele unentgeltlich erhältliche Apps aus den App Stores keineswegs völlig kostenfrei sind. Denn «nichts im Internet ist kostenlos»10, sagt Kempf. Und wenn nicht in Euro und Cent, so «zahlen die Nutzer doch mit ihren persönlichen Daten»11. «Daten sind die Währung des Internets», sagt auch Bundesverbraucherministerin Aigner. Die Gegenleistung besteht häufig in der Überlassung personenbezogener Daten an Anbieter, welche diese Daten wiederum zumeist entgeltlich an fast ausschließlich im Bereich Datenanalyse tätige, auf Gewinn ausgerichtete Unternehmen wie Flurry, Localytics und Mobclix weitergeben.

Beispielhaft verdeutlicht der App-Primus12 «WhatsApp» das datenschutzrechtliche Dilemma. Noch vor wenigen Monaten behielt sich dessen Anbieter das Recht vor, personenbezogene Daten der Anwender an Dritte weiterzugeben, verlangte Zugriff sowohl auf E-Mail-Adresse, Handynummer als auch das komplette Telefonbuch des Anwenders und übertrug Nachrichten unverschlüsselt. Daraufhin wurde die App gemeinsam durch den niederländischen und den kanadischen Datenschutzbeauftragten untersucht und die Ergebnisse am 28.01.2013 per Pressemitteilung13 mitgeteilt. Danach hat der Anbieter bereits während der Untersuchung Änderungen zum Schutz der persönlichen Informationen vorgenommen beziehungsweise will er weitere Änderungen durchführen. Jacob Kohnstamm, niederländischer Datenschutzbeauftragter, bemängelt trotz dieser Fortschritte, dass bestimmte Verhaltensweisen der App noch immer gegen niederländisches und kanadisches Datenschutzrecht verstoßen.14

2.3.

Relevantes Kollisions- und Sachrecht ^

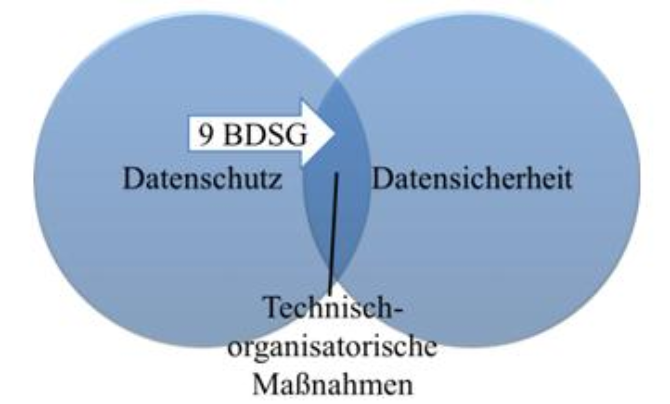

Um zu wissen, an welcher Stelle technisch-organisatorische Maßnahmen denn das Recht als solches komplementieren müssen, muss festgestellt werden, welches Recht Anwendung findet. Da Drittfirmen wie Flurry, Localytics oder Mobclix, deren Geschäftsmodell auf der entgeltlichen Weitergabe aufbereiteter personenbezogener Daten aus Apps beruht, ihren Sitz oft im Ausland haben, ist fraglich, ob deutsches Datenschutzrecht kollisionsrechtlich einschlägig ist, vgl. § 1 Abs. 5 S. 2 BDSG. Zu einer Anwendung des BDSG gelangt man sowohl über das Territorialitäts- als auch das Sitzprinzip. Ersteres gilt, wenn ein Anbieter zwar im EU/EWR-Ausland seinen Sitz hat, jedoch «Mittel» (Art. 4 Abs. 1 lit. c der EU-Datenschutzrichtlinie15) verwendet, die in Deutschland belegen sind; ein solches Mittel ist eine App16. Hat der Anbieter seinen Sitz innerhalb der EU/EWR, so findet das im jeweiligen Mitgliedsstaat geltende Datenschutzrecht Anwendung, sofern nicht ausnahmsweise der Umgang mit personenbezogenen Daten durch eine deutsche Niederlassung erfolgt. Wegen der Vollharmonisierung des europäischen Datenschutzrechts ist das Sitzprinzip nur noch von untergeordneter Bedeutung.

Anstatt einer personenbezogenen17 IP-Adresse wird im mobilen Bereich die ebenfalls personenbezogene «unique device identifier» (UDID) verwendet. Name, Adresse, E-Mail-Adresse, Handynummer u.a. sind ebenso personenbezogene Daten (§ 3 Abs. 1 BDSG). Der Anbieter einer App ist somit verantwortliche Stelle (§ 3 Abs. 7 BDSG). Sachrechtlich ist das deutsche Datenschutzrecht einschlägig. Zudem ist im nationalen Recht wegen § 1 Abs. 3 S. 1 BDSG auf die Abgrenzung von BDSG, TMG18 und TKG19 einzugehen; letztere könnten dem BDSG eventuell als bereichsspezifischere Regelungen (§ 11 ff. TMG und §§ 91 ff. TKG) vorgehen.

2.4.

Recht auf Anonymität oder Pseudonymität ^

2.5.1.

Verbotsprinzip ^

2.5.2.

Einwilligung ^

Das Recht trifft auch besondere Vorkehrungen hinsichtlich der Minderjährigkeit der Anwender, Apps treffen diese meist nicht. Zwar verlangt §4a Abs. 1 S. 1 BDSG lediglich Einsichtsfähigkeit in die Tragweite der Einwilligung, nicht auch Geschäftsfähigkeit.20 Wann aber von einer Einsichtsfähigkeit ausgegangen werden kann, bedarf einer Einzelfallabwägung, die wiederum von dem Verwendungszweck der personenbezogenen Daten abhängt.

2.5.3.

Erlaubnistatbestände ^

3.1.1.

Privacy by Design (PbD) ^

Die Ziele des PbD können durch die Anwendung der folgenden 7 Grundprinzipien erreicht werden:

- Proaktiv, nicht reaktiv, als Vorbeugung nicht als Abhilfe: Durch technische Maßnahmen soll ein Verstoß gegen datenschutzrechtliche Vorschriften vermieden werden, bevor sie eintreten.

- Datenschutz als Standardeinstellung: Das aktuell höchste Datenschutzniveau wird als Basisstandard voreingestellt.

- In das Design eingebetteter Datenschutz: Datenschutzrechtlich relevante Vorgänge werden bereits im Entwicklungsstadium berücksichtigt.

- Volle Funktionalität, eine Positivsumme, keine Nullsumme: Die mit dem Datenschutz kollidierende Funktionalität wird angemessen berücksichtigt.

- Konstanter Schutz während des gesamten Lebenszyklus: Datenschutzrelevante Aspekte sollen während des gesamten Umgangs mit den personenbezogenen Daten, von der Erhebung bis zur Löschung, berücksichtigt werden.

- Sichtbarkeit und Transparenz: Der Betroffene ist von Anfang an umfassend zu informieren, wie mit seinen personenbezogenen Daten umgegangen wird.

- Durch nutzerzentrierte Gestaltung die Privatsphäre der Nutzer wahren: Die Technik soll es dem Nutzer ermöglichen, die Datenschutzeinstellungen selbst zu bestimmen.

3.1.2.

Privacy by ReDesign (PbRD) ^

Viele Organisationen operieren mit bestehenden, relativ ausgereiften IT-Systemen und Unternehmenspraktiken, die sie über die Jahre entwickelt haben und die untrennbar mit alltäglichen Geschäftsabläufen verbunden sind. Solche Systeme auszutauschen steht dann meist nicht auf der Agenda. Die Aufgabe der Implementierung von PbD in solche Systeme kommt dann dem PbRD zu, einer Erweiterung von PbD. Bezogen auf Smart Devices muss bei bereits in Service Operation laufenden Apps das Ziel sein, sich dem Endzustand von PbD, den höchsten Standards für den Schutz personenbezogener Daten, zu nähern. Dies soll laut der Urheberin von PbD unterstützt werden durch die «3 R» des PbRD: «Rethink, Redesign, and Revive».

- Rethink (Umdenken) lädt Unternehmen ein, ihre Strategien zur Risikominderung zu überprüfen, für ihre Systeme und Prozesse – einschließlich Informationstechnologien, Geschäftspraktiken, physikalisches Design, und vernetzte Infrastruktur – alternative Ansätze zu finden, die einen besseren Datenschutz innerhalb der App gewährleisten. Dies kann auch Untersuchungen darüber einschließen, wie viele personenbezogene Daten überhaupt für die App notwendig sind und wie lange diese für den Betrieb bereitgehalten werden müssen.

- Redesign (Neugestalten) bietet die Chance, Verbesserungen umzusetzen, einerseits einen funktionaleren Datenschutz zu implementieren, gleichermaßen aber auch dafür Sorge zu tragen, dass die wichtigsten Business-Anforderungen in einer win-win-Beziehung erreicht werden. Eine Neugestaltung wird wahrscheinlich dann spiegelbildlich bei bestehenden Datenbanken beachtet werden, Daten müssen kaskadiert und gelöscht werden, unnötige Datenfelder beseitigt werden.

- Revive (Wiederbeleben) des Systems in einer neuen, den Datenschutz verbessernden Umgebung, ist das endgültige Ziel.

3.2.

Privacy by ReDesign im (künftigen) Gemeinschaftsrecht ^

Im europäischen Gemeinschaftsrecht existiert keine ausdrückliche Verpflichtung, datenschutzrechtliche Aspekte bereits während Entwicklung und Herstellung einer App zu beachten. Dies soll sich mit dem aktuellen Entwurf der Europäischen Datenschutz-Grundverordnung21 und der Europäischen Datenschutzrichtlinie22 ändern. Beide23 sehen die Verpflichtung zur Vornahme von technischen und organisatorischen Maßnahmen und Verfahren zur Wahrung der Betroffenenrechte vor. Dies bedeutet für die Akzeptanz von PbRD einen wesentlichen Fortschritt, da» «data protection by design and by default»Vgl. Art. 23 der Grundverordnung sowie Art. 19 der Richtlinie.24 so unmittelbar geltendes Recht innerhalb der EU/EWR würde.

3.3.

Privacy by ReDesign im geltenden deutschen Recht ^

3.4.

Herausforderungen ^

- Einwilligung des Anwenders: Eine elektronische Einwilligung ist rechtlich möglich, müsste technisch aber ebenso einige Herausforderungen meistern. Zum einen ist die Schaltfläche, mit der eingewilligt wird, deutlich darzustellen, damit die Einwilligung wissentlich und willentlich erteilt wird. Der Anwender muss «informiert» einwilligen, bedeutet für das Design die Integration von einigem Aufklärungstext an geeigneter, gut erkennbarer Stelle. Diese Aufklärung des Anwenders ist bisher selten ausreichend einsehbar, gar versteckt oder wird anderen Nutzungsbedingungen «untergemischt», was wegen der mangelnden «Informiertheit» des Anwenders dann gegen § 4 Abs. 1 S. 4 BDSG verstoßen kann. Es muss der Hinweis des Anbieters auf Art, Umfang und Zweck des Umgangs mit personenbezogenen Daten zu finden sein. Weiterhin muss es dem Anwender möglich sein, andere vergleichbare Dienste des Anbieters zu nutzen, selbst wenn er bei einem Dienst dieses Anbieters nicht einwilligt. Zuletzt muss das «Einwilligungsverhalten» des Anwenders durchgehend protokolliert werden, jederzeit abrufbar und widerrufbar sein. Will, so Kremer, «der Anbieter der App auf das für ihn riskante Spiel mit der Einwilligung verzichten, ist er gezwungen, für jeden einzelnen Schritt bei Erhebung und Verwendung der personenbezogenen Daten durch seine App eine gesetzliche Grundlage zu finden […]»25. Es wäre allenfalls möglich, so Kremer weiter, «die Einwilligung des Anwenders nicht mehr im Ganzen einzuholen, sondern nach und nach für einzelne Funktionalitäten einer App Teil-Einwilligungen einzuholen […]»26.

- Anonymität und Pseudonymität: Dem Anwender sollte die anonyme oder pseudonyme Nutzung seiner Telemediendienste ermöglicht werden. Hier besteht möglicherweise das politische Problem, dass noch immer davon ausgegangen wird, dass anonymisierte Teilnahme an solchen Diensten die Gefahr von Rechtsverletzungen zu Lasten Dritter erhöht. Zudem zeigte das Beispiel Google+, dass eine Anonymisierung oder Pseudonymisierung bei umfangreicheren, bekannteren Diensten oft leerläuft. Anwender von Google+, die dort Spitznamen verwenden, werden von den übrigen Google Diensten dennoch erkannt und weiterhin öffentlich mit dem richtigen Namen geführt.

- Mehrere Nutzer: Das Risiko der Nutzung von Smart Devices durch mehrere Anwender könnte reduziert werden, wenn der App-Anbieter den Anwender durch entsprechende Nutzungsbedingungen wirksam dazu verpflichtet, sein Smart Device vor der Nutzung durch andere Anwender zu sichern, beispielsweise ihm einen kostenfreien Zusatzservice zur Installation anbietet, der Zugangssperren einrichtet, oder aber die Nutzung der App selbst erst nach erfolgreicher Bewältigung einer App-bezogenen Zugangssperre ermöglicht.

- Verantwortliche Stelle: Grundsätzlich gibt es nach der Systematik des BDSG nur eine «verantwortliche Stelle» (§ 3 Abs. 7 BDSG) bei Apps, nämlich den Anbieter, der umfassende Einwirkungsmöglichkeiten auf die Programmierung der Software hat oder zugleich selber der Entwickler der Software ist. PbRD würde dazu führen, dass Hersteller und Entwickler von Soft- und Hardware verpflichtend Gestaltungen implementieren müssen und ggfs. sanktioniert werden können, falls sie dies nicht tun. Sie wären dann allerdings quasi «verantwortliche Stelle neben der verantwortlichen Stelle». Es bleibt abzuwarten, ob diese Verschiebung / Verdopplung der Verantwortlichkeit nicht mit Art. 12 und 14 GG27 kollidiert und wo der deutsche Gesetzgeber dies thematisch verorten will.

- Datenschutz ex ante: Grundsätzlich gilt die datenschutzrechtliche Verantwortlichkeit erst dann, wenn mit den personenbezogenen Daten umgegangen wird. Allenfalls § 3a BDSG, das Prinzip der Datenvermeidung und Datensparsamkeit «strahlt bereits de lege lata in das Vorfeld dieses Anwendungsbereiches aus»28. PbRD wäre dann zu beachten, bevor auch nur ein personenbezogenes Datum erhoben wurde. Ob eine App-Funktion Gefahren für die informationelle Selbstbestimmung des Betroffenen birgt, wird im Zweifel erst über eine im Vorfeld durchzuführende «Technikfolgenabschätzung» bestimmbar sein; grundsätzlich kann eine solche Abschätzung funktionieren, wie das Beispiel der RFID-Anwendungen zeigte.29 Die Kehrseite: Eine Dämonisierung noch nicht näher bestimmter, unmöglich genau abzuschätzender Gefahren durch technische Entwicklung für den betroffenen Anwender.

- Wirtschaftlichkeit: Belastbare Vorhersagen hinsichtlich der Wirtschaftlichkeit einer App, die verpflichtend Prinzipien des PbRD in sich trägt, sind oft nur schwer und unter zusätzlichen Kosten machbar. U.a. ist weder vorhersehbar, wie sich der Markt für Apps entwickeln wird, die mehr oder weniger auf Datenschutz Rücksicht nehmen, noch ist abzuschätzen, wie die Aufsichtsbehörden auf technische Neuerungen in Apps reagieren.

- Bedienbarkeit: Wird eine App mit ausschließlich vordefinierten und als unbedenklich eingestuften Funktionalitäten betrieben und dabei der Umgang mit personenbezogenen Daten minimiert, so leidet darunter sicherlich die Bedienbarkeit. Vielmehr sollte die App flexibel gestaltet werden, Upgrades und Updates zur Verfügung gestellt werden und dem Anwender selbst die Möglichkeit gegeben werden, in bestimmtem Umfang seine Privacy-Einstellungen nicht nur zu aktualisieren, sondern selber manuell anzupassen.

4.

Ausblick ^

Die Chancen von PbD und PbRD sind groß, die Fronten in Teilfragen allerdings noch verhärtet:

- Pro Spielraum für die Anbieter: «Wenn selbst die Herstellung und das Inverkehrbringen von Kriegswaffen nach behördlicher Genehmigung zulässig ist, können an Softwareentwickler gerichtete Totalverbote nicht der Weisheit letzter Schluss sein»30.

- Contra Spielraum für die Anbieter: Die oberste Staatsanwältin des US-Staates Kalifornien, Kamala Harris, fordert von einer Vielzahl an Betreibern von App-Stores und App-Entwicklern ein Bußgeld von 2.500 Dollar pro Download einer App ein, die gegen die scharfen kalifornischen Datenschutzgesetze verstößt. Diese31 besagen u.a., dass jede App an einer prominenten Stelle den Nutzer informieren muss, welche persönlichen Daten sie speichert und was mit diesen Daten passiert.

Was bleibt? Die künftige Lösung liegt wohl in der salomonischen Mitte. Bis dahin kann nach Meinung des Autors auf die Empfehlungen der GSM Association zurückgegriffen werden, die im Februar 2012 hervorragende «Privacy Design Guidelines for Mobile Application Development’32 veröffentlicht hat und eine Liste technisch-organisatorischer Maßnahmen – in thematische Bereiche unterteilt – vorschlägt.

5.

Literatur ^

Hoeren, Thomas, Google Analytics – datenschutzrechtlich unbedenklich? Verwendbarkeit von Webtracking-Tools nach BDSG und TMG, In: Zeitschrift für Datenschutz (ZD), Heft 1, Seite 3-6 (2011)

Jandt, Silke/Roßnagel, Alexander, Social Networks für Kinder und Jugendliche – Besteht ein ausreichender Datenschutz?, Multimedia und Recht (MMR), Heft 10, Seite 637-642 (2011)

Kremer, Sascha, Datenschutz bei Entwicklung und Nutzung von Apps für Smart Devices, Computer und Recht (CR), Heft 7, Seite 438-446 (2012)

Schulz, Sebastian, Privacy by Design, Computer und Recht (CR), Heft 3, Seite 204-208 (2012)

Stadler, Thomas, Verstoßen Facebook und Google Plus gegen deutsches Recht? – Ausschluss von Pseudonymen auf Social-Media-Plattformen, Zeitschrift für Datenschutz (ZD), Heft 2, Seite 57-59 (2011)

Wintermeier, Martin, Inanspruchnahme sozialer Netzwerke durch Minderjährige – Datenschutz aus dem Blickwinkel des Vertragsrechts, Zeitschrift für Datenschutz (ZD), Heft 5, Seite 210-215 (2012)

Philipp E. Fischer, LL.M. (Intellectual Property Law, London / Dresden), Datenschutzbeauftragter & -auditor (TÜV), ITIL® Expert, Geschäftsführer, SuiGeneris Consulting.

- 1 Bundesdatenschutzgesetz in der Fassung der Bekanntmachung vom 14. Januar 2003 (BGBl. I S. 66), das zuletzt durch Artikel 1 des Gesetzes vom 14. August 2009 (BGBl. I S. 2814) geändert worden ist.

- 2 Stiftung Warentest Magazin, Juni 2012, Seite 1.

- 3 Die Welt vom 07.02.2012, «IT-Branche fürchtet Datenschutz als Konsumbremse», abrufbar unter http://www.welt.de /politik/deutschland/article13855394/IT-Branche-fuerchtet-Datenschutz-als-Konsumbremse.html.

- 4 Die Zeit vom 24.05.2012, abrufbar unter http://www.zeit.de/digital/datenschutz/2012-05/apps-datenschutz-warentest

- 5 www.privacybydesign.ca.

- 6 http://www.computerwoche.de/a/smartphones-und-tablets-weiter-im-aufwind,2526981.

- 7 http://de.statista.com/statistik/daten/studie/198959/umfrage/anzahl-der-smartphonenutzer-in-deutschland-seit-2010/.

- 8 http://www.handelsblatt.com/technologie/it-tk/mobile-welt/safer-internet-day-bei-smartphones-verstaerkt-auf-datenschutz-achten/6178736.html.

- 9 http://www.handelsblatt.com/technologie/it-tk/mobile-welt/safer-internet-day-bei-smartphones-verstaerkt-auf-datenschutz-achten/6178736.html.

- 10 http://www.welt.de/politik/deutschland/article13855394/IT-Branche-fuerchtet-Datenschutz-als-Konsumbremse.html.

- 11 http://www.welt.de/politik/deutschland/article13855394/IT-Branche-fuerchtet-Datenschutz-als-Konsumbremse.html.

- 12 Mit Stand 30.01.2013 die weltweit am häufigsten verkaufte non-games App sowohl in Apple´s App Store als auch in Google´s Play Store.

- 13 http://www.priv.gc.ca/media/nr-c/2013/nr-c_130128_e.asp.

- 14 http://www.priv.gc.ca/media/nr-c/2013/nr-c_130128_e.asp.

- 15 Richtlinie 95/46/EG des Europäischen Parlaments und des Rates vom 24. Oktober 1995 zum Schutz natürlicher Personen bei der Verarbeitung personenbezogener Daten und zum freien Datenverkehr, Amtsblatt Nr. L 281 vom 23/11/1995 S. 0031 – 0050.

- 16 Zustimmend Stadler, S. 58.

- 17 Unter anderen Hoeren, S. 4.

- 18 Telemediengesetz vom 26. Februar 2007 (BGBl. I S. 179), das zuletzt durch Artikel 1 des Gesetzes vom 31. Mai 2010 (BGBl. I S. 692) geändert worden ist.

- 19 Telekommunikationsgesetz vom 22. Juni 2004 (BGBl. I S. 1190), das zuletzt durch Artikel 1 des Gesetzes vom 3. Mai 2012 (BGBl. I S. 958) geändert worden ist.

- 20 Wintermeier, S. 212; Jandt/Roßnagel, S. 640.

- 21 Vorschlag für Verordnung des Europäischen Parlaments und des Rates zum Schutz natürlicher Personen bei der Verarbeitung personenbezogener Daten und zum freien Datenverkehr (Datenschutz-Grundverordnung), KOM/2012/011, abrufbar unter http://ec.europa.eu/justice/data-protection/document/review2012 /com_2012_11_de.pdf.

- 22 http://ec.europa.eu/justice/data-protection/document/review2012/com_2012_10_de.pdf.

- 23 Die Grundverordnung in Erwägungsgrund (66), die Richtlinie in Erwägungsgrund (46).

- 24 Vgl. Art. 23 der Grundverordnung sowie Art. 19 der Richtlinie.

- 25 Kremer, S. 446.

- 26 Kremer, S. 446.

- 27 Grundgesetz für die Bundesrepublik Deutschland vom 23. Mai 1949 (BGBl. S. 1), zuletzt geändert durch das Gesetz vom 21. Juli 2010 (BGBl. I S. 944).

- 28 Schulz, S. 207.

- 29 Im April 2011 wurde ein Rahmenwerk zur Datenschutzfolgenabschätzung für RFID-Anwendungen verabschiedet, https://www.bsi.bund.de/SharedDocs/Downloads/DE/BSI/ElekAusweise/ PIA/Privacy_Impact_Assessment_Guideline_Langfassung.pdf?__blob=publicationFile.

- 30 Schulz, S. 207.

- 31 California Online Privacy Protection Act (COPPA).

- 32 http://www.gsma.com/publicpolicy/mobile-and-privacy/design-guidelines.